BERT 사전 학습 모델 (Pre-trained model)

- pytorch-transformers를 설치합니다.

!pip install pytorch-transformers

- 다음을 입력하여 BERT 사전 학습 모델을 설치하여줍니다.

import torch

from pytorch_transformers import BertTokenizer, BertForSequenceClassification, BertConfig

device = torch.device("cuda")

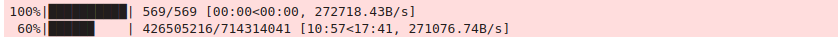

tokenizer = BertTokenizer.from_pretrained('bert-base-multilingual-cased')

model = BertForSequenceClassification.from_pretrained('bert-base-multilingual-cased')

model.to(device)

BERT는 다양한 model을 가지고 있습니다. 아래의 github 페이지에서 Quick tour를 보시고 원하는 모델을 사용할 수 있습니다.

https://github.com/huggingface/transformers

huggingface/transformers

🤗 Transformers: State-of-the-art Natural Language Processing for TensorFlow 2.0 and PyTorch. - huggingface/transformers

github.com

반응형

'Programming > (Python)(Ubuntu)' 카테고리의 다른 글

| 우분투 Read-only 문제 해결 (0) | 2020.05.29 |

|---|---|

| Python Decorator(데코레이터) @의 의미 (0) | 2020.04.30 |

| Transfer Learning(전이 학습) (0) | 2020.04.23 |

| PyTorch-Basic (tensor 선언/연산, model parameters/epoch/loss) (0) | 2020.04.04 |

| BART: Denoising Sequence-to-Sequence Pre-training for Natural Language Generation, Translation, and Comprehension 바트 모델(Bart model) (0) | 2020.04.02 |